Çevrimiçi dünyada bireylerin gördüğü ve duyduğu içeriklerin kaynağını anlamalarına ve orijinalliğini incelemelerine yardımcı olmak isteyen OpenAI, yapay zeka platformları aracılığıyla yaratılan içerikleri tespit eden yeni bir araç geliştirdi.

Üretken yapay zeka teknolojileriyle oluşturulan görsel ve işitsel içeriklerin daha da yaygınlaşmasıyla harekete geçen OpenAI, bireylerin içeriklerin nasıl oluşturulduğuna dair daha kapsamlı bir şekilde bilgilendirilmeleri gerektiğine inanıyor.

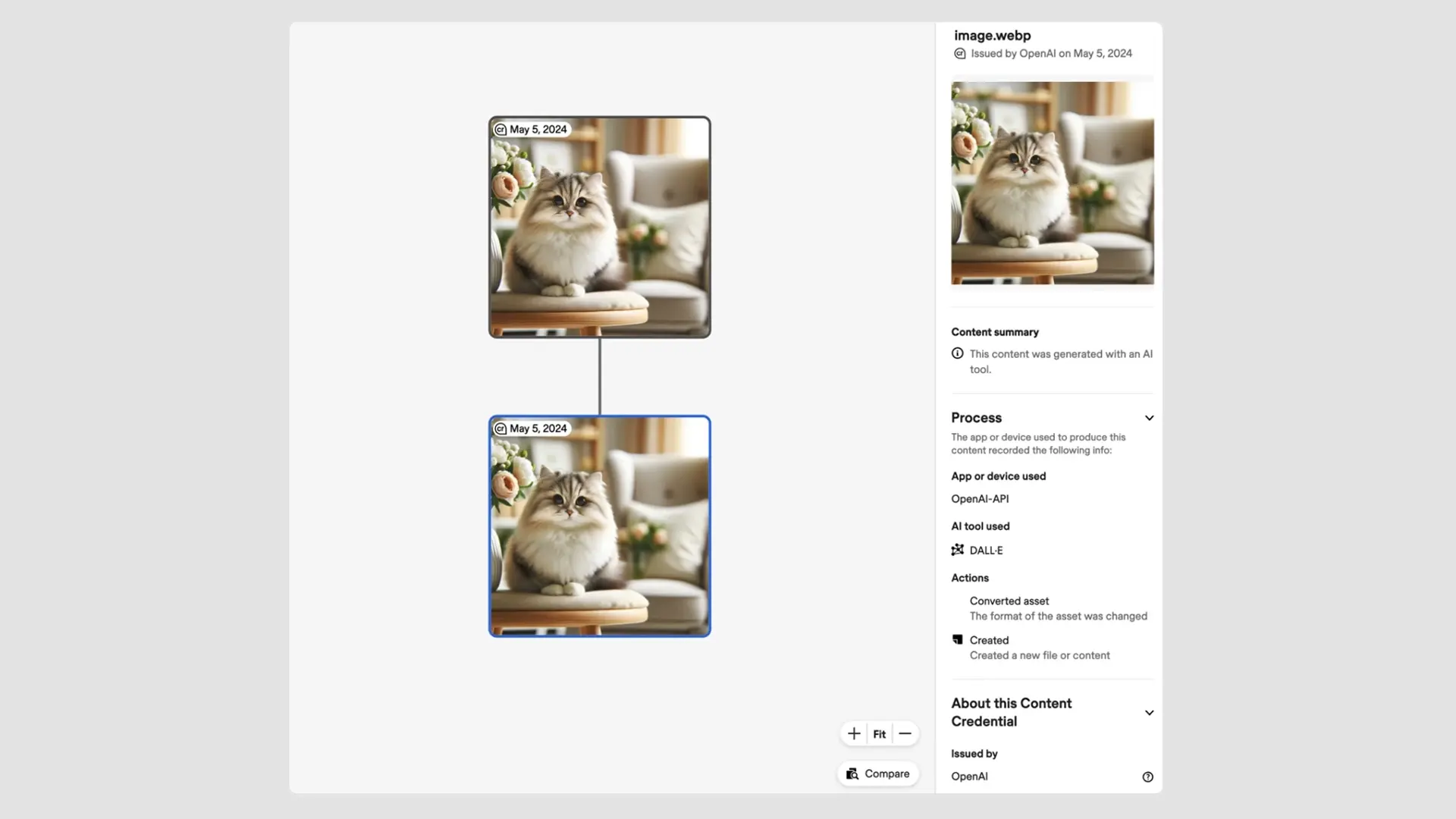

Geçtiğimiz gün yaptığı duyuruyla bu konudaki ilk adımlarını atan şirket, deepfake içeriklerle ilgili bilgilendirmelerin ortak bir standartı olması gerekliliğine parmak basarak C2PA'e (The Coalition for Content Provenance and Authenticity) katıldığını duyurdu.

Yazılım şirketleri, kamera üreticileri ve birçok dijital yayıncının da benimsediği teknik standart olarak görülen C2PA, medya içeriklerinin kaynağını ve değişim takibini sağlayarak güvenilirliklerini ortaya koymayı amaçlıyor.

Geri bildirim almak üzere Researcher Access Program'ı sınırlı bir grup araştırma laboratuvarı, gazeteci ve kâr amacı gütmeyen kuruluş için erişime açan OpenAI, kullanıcıların bir görüntünün DALL-3 tarafından oluşulma olasılığını görebileceklerini söyledi.

Yeni aracın OpenAI ürünlerinde %98 doğruluk payıyla çalıştığını açıklayan yapay zeka devi, içeriğin ne zaman ve nasıl değiştirildiği konusunda kullanıcılara bilgiler veriyor.

Popüler İçerikler